Un nuovo dispositivo che non ci obblighi a scegliere tra reale e virtuale, guidato un’interfaccia neurale. Il punto di Menlo Park

Un mondo in cui un paio di occhiali sia in grado di sostituire il computer o lo smartphone. Un’Intelligenza Artificiale sensibile al contesto per aiutare le persone a navigare nel mondo, senza distogliere l’attenzione, perché si sta guardando uno schermo. Un dispositivo che non costringerebbe a scegliere tra il mondo reale e il mondo digitale.

Trasformare l’intenzione in azione

“Perché però l’AR diventi veramente onnipresente, è necessaria una tecnologia a basso attrito e sempre disponibile che sia così intuitiva da usare da diventare un’estensione del tuo corpo” ha spiegato Michael Abrash, Chief Scientist dei Facebook Reality Labs. Questa interfaccia AR dovrà essere proattiva piuttosto che reattiva. Sarà un’interfaccia che trasforma l’intenzione in azione senza soluzione di continuità, dandoci più libertà d’azione nelle nostre vite e permettendoci di rimanere presenti con coloro che ci circondano. Dovrà poi essere socialmente accettabile sotto ogni aspetto: sicura, privata, discreta, facile da imparare, facile da usare, comoda e indossabile tutto il giorno, semplice e affidabile. Magari da mettere al polso.

I Facebook Reality Labs Research. A questo stanno lavorando i ricercatori del Facebook Reality Labs Research. L’unità di ricerca di Menlo Park sta sviluppando un’interfaccia per la realtà aumentata che non costringerà a scegliere tra l’interazione con i propri dispositivi e il mondo che ci circonda. “Stiamo sviluppando – fanno sapere gli esperti della piattaforma – soluzioni più naturali e intuitive per interagire con gli occhiali per la realtà aumentata always-on. Anziché richiamare la nostra attenzione su una periferica nel palmo della mano, come ad esempio un cellulare, gli occhiali per la realtà aumentata vedranno il mondo esattamente come lo vediamo noi. Gli occhiali metteranno per la prima volta l’uomo al centro dell’esperienza informatica e ci riproporranno una realtà digitale in tre dimensioni per aiutarci a comunicare, navigare, imparare, condividere ed eseguire azioni nel concreto”.

Inside the Lab. Si è parlato anche di questo nel corso del primo appuntamento di Inside the Lab, dedicato alle ultime ricerche nel campo della Realtà Aumentata realizzate da Facebook Reality Labs. La serie di tavole rotonde ha lo scopo è di aiutare a contestualizzare la ricerca e le tecnologie che Facebook sta sviluppando e raccontare le scommesse dell’azienda, in termini di innovazione a lungo termine.

Una nuova interfaccia per la realtà aumentata

Al Facebook Reality Labs, poi diventata Oculus Research, sei anni fa si è costituito un team altamente interdisciplinare, guidato da Sean Keller e composto da ricercatori, ingegneri, neuroscienziati: l’obiettivo è risolvere il problema dell’interazione AR e arrivare al prossimo grande cambiamento di paradigma dell’informatica. “Pensiamo all’input e all’output dal punto di vista del computer, ma l’interazione AR è un caso speciale: stiamo costruendo un nuovo tipo di computer indossabile che rileva, apprende e agisce di concerto con gli utenti durante la loro giornata” ha spiegato proprio Keller.

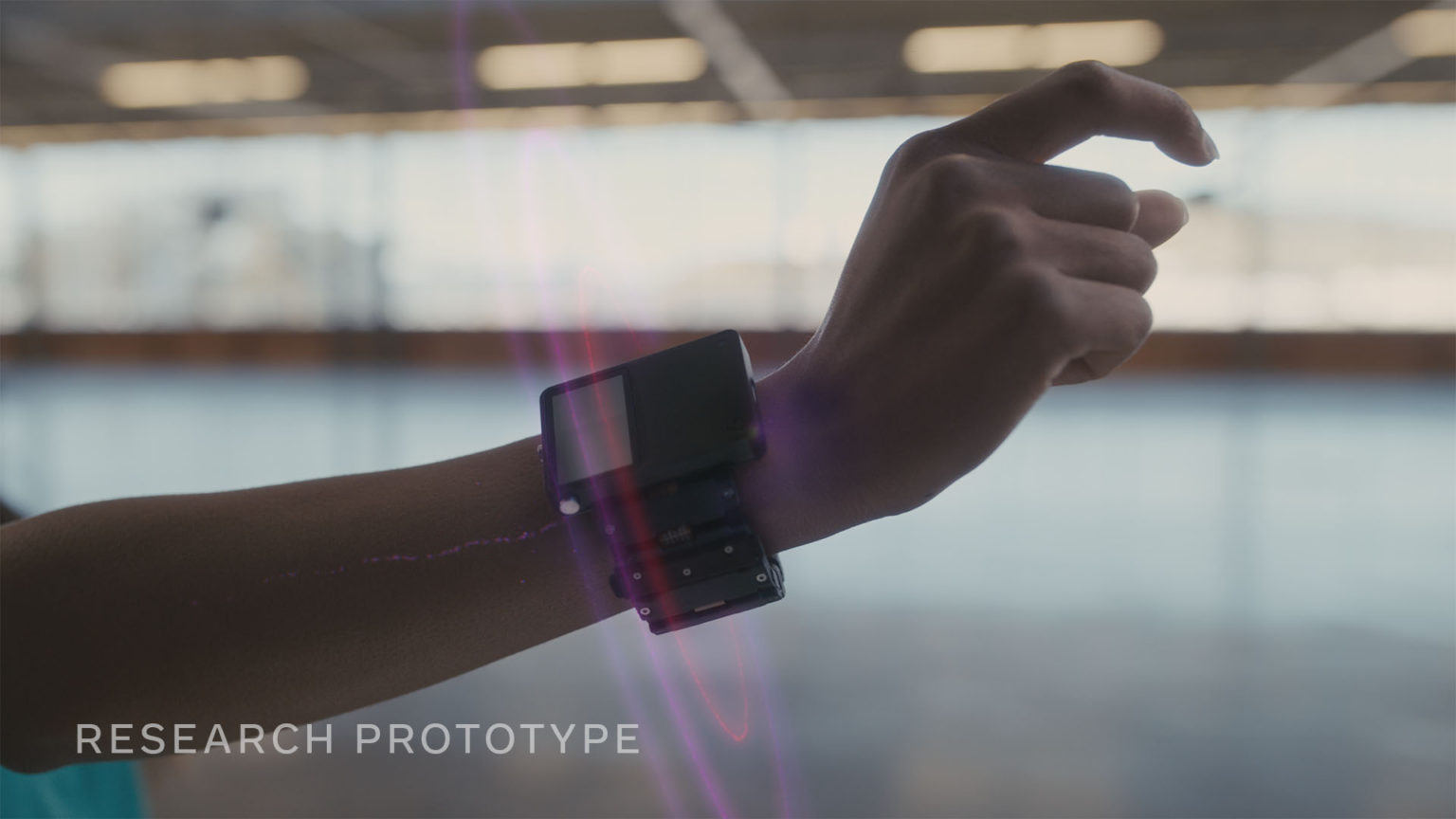

Al polso. Se l’obiettivo dei ricercatori era sviluppare una tecnologia di input onnipresente, in grado di soddisfare le molteplici esigenze che persone di tutti i tipi incontrano nel corso della giornata, il sistema doveva tenere conto della privacy, della sicurezza e della protezione, dando alle persone modi significativi per personalizzare e controllare la loro esperienza di Realtà Aumentata. L’interfaccia doveva anche essere intuitiva, sempre disponibile, non invasiva e facile da usare. Idealmente, doveva supportare una larghezza di banda tale da consentire un funzionamento ottimale, dalla manipolazione di un oggetto virtuale alla modifica di un documento. Non da ultimo, doveva avere un formato sufficientemente confortevole per essere indossato tutto il giorno e garantire consumi ridotti. La scelta è caduta sul polso

Perché. Il polso era la scelta ideale per un dispositivo di input: è la parte del corpo che ospita di solito un orologio, pertanto si adatta alla vita di tutti i giorni e a tutti i contesti sociali. È una posizione comoda per un accessorio da indossare tutto il giorno. Si trova accanto ai principali strumenti che usiamo per interagire con il mondo: le mani. Questa vicinanza consentiva poi di portare le molteplici capacità di controllo delle mani nella realtà aumentata, aprendo le porte a interazioni intuitive, efficaci e soddisfacenti. Un altro vantaggio di un dispositivo indossabile da polso era quello di poter fungere da interfaccia informatica e da piattaforma per la batteria e le antenne, supportando al contempo un’ampia gamma di sensori.

Che cosa si può fare. Con i sensori sul polso, si può interagire con oggetti virtuali o controllare l’ambiente del proprio salotto quasi senza attrito. Con un input basato sul polso senza attriti, le interfacce adattive alimentate dall’IA consapevole del contesto e dal feedback tattile, possiamo comunicare con i nostri dispositivi senza distrazioni, possiamo connetterci con gli altri e migliorare la nostra vita. E chi è nato senza una mano può anche imparare ad usarne una virtuale.

L’interfaccia neurale

A questo punto era necessario uno strumento in grado di ottenere un input sfaccettato. La scelta è caduta sull’elettromiografia, tecnologia che usa dei sensori per tradurre gli impulsi elettrici dei motoneuroni trasmessi dal midollo spinale al polso fino alla mano in comandi digitali utilizzabili per controllare le funzioni di un dispositivo. I segnali che passano dal polso sono talmente chiari che l’EMG, questo il suo acronimo, può dedurre anche movimenti minimi delle dita (anche solo di un millimetro). Ciò significa che si possono trasmettere input senza sforzo. Potrebbe essere addirittura possibile percepire solo l’intenzione di muovere un dito.

Controllo diretto della macchina. “Ciò che stiamo cercando di fare con le interfacce neurali è consentire alle persone il controllo diretto della macchina grazie ai segnali del sistema nervoso periferico, ossia dei nervi al di fuori del cervello responsabili del movimento delle mani e delle dita” ha spiegato Thomas Reardon, Director of Neuromotor Interfaces di FRL, che si unito al team di FRL quando Facebook ha acquisito CTRL-Labs nel 2019.

Il futuro. Un giorno, l’EMG si arricchirà con controlli più avanzati. Nella Realtà Aumentata, sarà possibile toccare e spostare l’interfaccia utente e gli oggetti virtuali, come è possibile vedere in questo video dimostrativo. Si potranno controllare gli oggetti virtuali a distanza. È un po’ come avere un superpotere. L’obiettivo delle “interfacce neurali è quello di stravolgere questa lunga tradizione di interazione uomo-computer per fare in modo che sia l’uomo ad avere più controllo sulle macchine, non viceversa. Vogliamo creare esperienze informatiche incentrate sulla persona” ha spiegato sempre Reardon.

La strada verso il click intelligente

Mentre gli input privi di attriti, come lo schiocco delle dita o altri microgesti, consentiranno di interagire con le interfacce adattive, c’è bisogno di un modo per chiudere il ciclo di retroazione e consentire al sistema di comunicare nuovamente con l’utente e rendere gli oggetti virtuali tangibili. È qui entra in gioco il tatto.

Esplorare le tecnologie tattili del braccialetto. Secondo Sean Keller, Science Director di FRL Research, “ci siamo evoluti e stiamo iniziando a sfruttare questi segnali tattili per conoscere il mondo. È il tatto che ci consente di imparare a usare strumenti e controlli raffinati. Dal chirurgo che usa il bisturi al pianista che suona sentendo i tasti del pianoforte, tutto dipende dalle sensazioni tattili. Il braccialetto è solo l’inizio. Non riusciamo a riprodurre ogni singola sensazione che potremmo provare interagendo con un oggetto vero nel mondo reale, ma stiamo iniziando a produrne una gamma discretamente numerosa. Al momento stiamo studiando una serie di prototipi unici pensati per aiutarci a esplorare le tecnologie tattili del braccialetto”.

Etica e interazione. Per costruire un’interfaccia umanocentrica per la Realtà Aumentata che possa essere usata nella vita di tutti i giorni, la privacy, la sicurezza e la protezione devono essere considerate come elementi di ricerca fondamentali e sono considerate alla base delle esplorazioni dei ricercatori nell’interazione basata sul polso. “Comprendere e risolvere l’intera portata dei problemi etici richiede un impegno a livello di società – ha spiegato Keller – semplicemente non potremo arrivarci da soli, quindi non stiamo cercando di farlo. Nell’inventare nuove tecnologie, ci impegniamo a condividere i nostri insegnamenti con la comunità e ad impegnarci in una discussione aperta per affrontare le preoccupazioni”.